一个开源的 AI 驱动搜索引擎项目,Perplexity AI 的开源平替

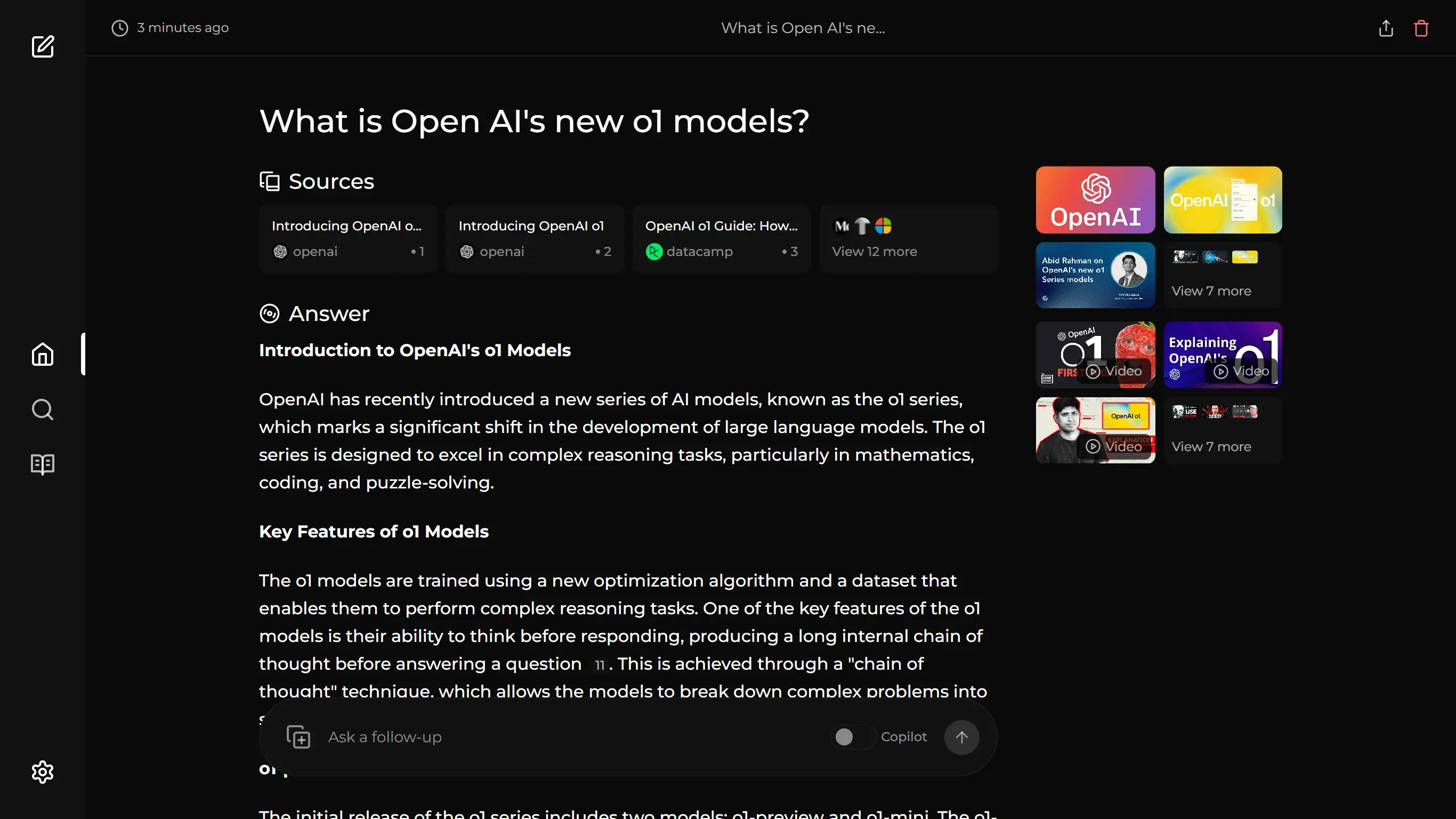

大家好,今天给大家分享一个基于先进人工智能技术构建的问答搜索引擎Perplexica,它与传统搜索引擎相比,更能理解用户问题的含义和意图,从而提供更为精确的搜索结果,帮助用户更快速地找到所需信息。

项目介绍

随着人工智能技术的发展,人们对于信息搜索的需求不断提高,传统搜索引擎在理解复杂查询意图和提供精准答案方面存在不足。Perplexica 应运而生,旨在为用户提供更智能、更精确的搜索体验,成为一个全面、高效的搜索解决方案,满足用户对各种类型信息的需求,同时保护用户隐私并提供最新的搜索结果。

功能特点

1.先进的机器学习算法

利用相似性搜索和嵌入式技术等先进的机器学习算法来优化搜索结果,不仅能够找到相关的网页,还能理解网页内容,从而提供更准确、更有针对性的答案,并附带来源引用,确保信息的准确性和可追溯性。

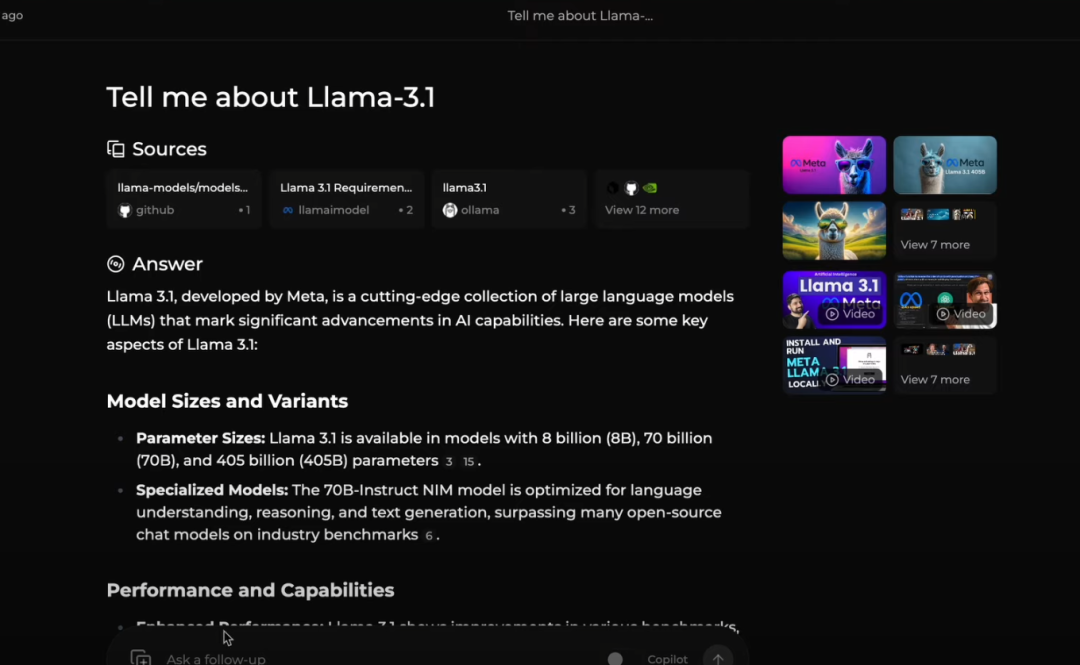

2.支持本地 LLMs

支持通过 Ollama 操作本地的大型语言模型,如 Llama3 和 Mixtral 等,即使在网络条件不佳的情况下,也能为用户提供出色的搜索体验,同时也增加了用户对数据的隐私控制。

3.多种搜索模式

正常模式:处理用户的查询并执行常规的网络搜索。

CoPilot 模式:通过生成不同的查询以找到更多相关网页,直接从页面中获取信息,从而提升搜索效率,不过目前该模式还在开发中。

焦点模式:包括全模式、写作助手模式、学术搜索模式、YouTube 搜索模式、Wolfram Alpha 搜索模式、Reddit 搜索模式等六种。这些模式可以满足不同用户在不同场景下的搜索需求,如学术研究人员可通过学术搜索模式查找学术文章和论文;普通用户可通过 YouTube 搜索模式找到相关的视频等 。

4.实时更新

借助 SearxNG,Perplexica 能够获取最新的搜索结果,保证信息的新鲜度,避免了传统搜索引擎可能出现的过时信息问题.

5.多模态搜索

支持图像和视频搜索,为用户提供更全面、更丰富的搜索体验.

应用场景

学术研究:研究人员可以利用 Perplexica 快速筛选大量的学术论文和研究资料,找到与自己研究课题相关的最新文献和数据,提高研究效率。

写作辅助:在写作过程中,Perplexica 的写作助手模式可以为用户提供灵感、查找参考资料、检查语法和拼写错误等,帮助用户更高效地完成写作任务。

日常生活:普通用户可以通过 Perplexica 查找各种生活问题的答案,如健康养生、旅游攻略、美食推荐等,还可以通过其视频搜索功能找到有趣的视频内容。

专业领域:不同专业领域的人士可以通过相应的焦点模式,如学术搜索模式、Wolfram Alpha 搜索模式等,获取专业领域内的最新信息和深入分析,帮助他们更好地了解行业动态和发展趋势。

企业应用:企业可以将 Perplexica 集成到内部系统中,用于检索市场趋势、竞争对手分析、技术研究等信息,提高企业的信息检索效率和决策能力。

安装使用

安装

Docker安装

确保系统已安装并运行Docker。

克隆Perplexica仓库:

git clone https://github.com/ItzCrazyKns/Perplexica.git。进入项目目录,将

sample.config.toml文件重命名为config.toml,并填写必要的配置信息。在包含

docker-compose.yaml文件的目录中执行Docker命令docker compose up -d启动服务。等待几分钟,然后通过浏览器访问

http://localhost:3000使用Perplexica。

非Docker安装

安装 SearXNG 并在其设置中允许JSON格式。

克隆仓库,将根目录中的

sample.config.toml文件重命名为config.toml并填写所有必填字段。将ui文件夹中的

.env.example文件重命名为.env并填写所有必要字段。填充配置和环境文件后,在ui文件夹和根目录中均运行

npm i。安装依赖后,在ui文件夹和根目录中均执行

npm run build。最后,在ui文件夹和根目录中均运行

npm run start以启动前端和后端。

推荐使用 Docker 安装,因为它简化了设置过程,特别是在管理环境变量和依赖项方面。如需了解更多信息,如将其暴露到网络等,请参阅安装文档。

使用

大模型配置

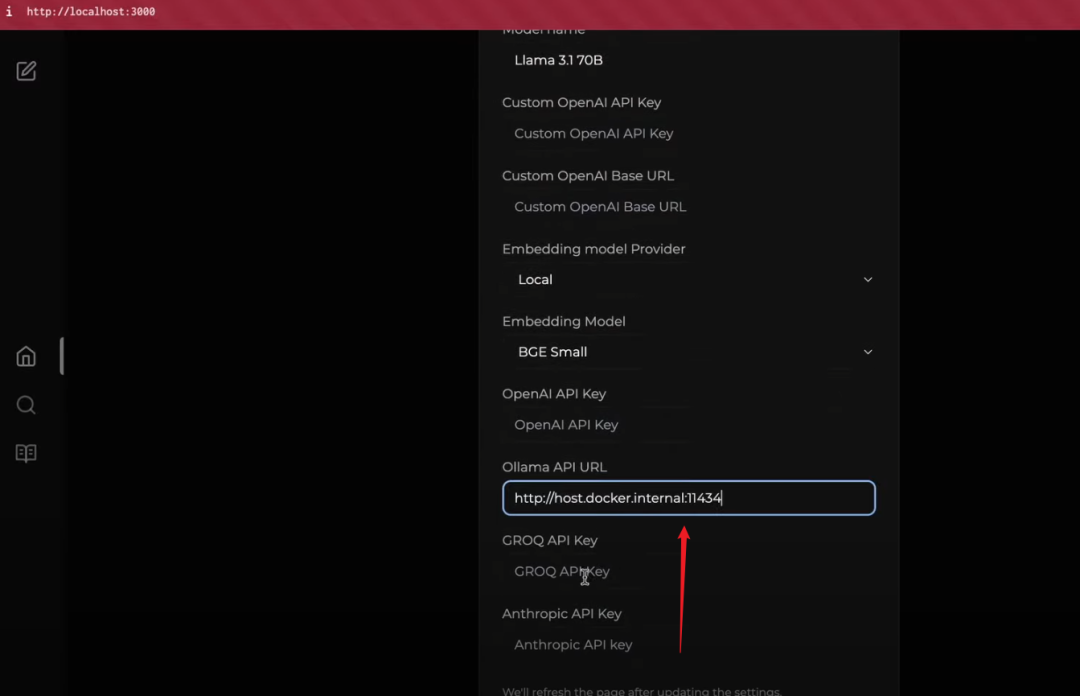

在config.toml中根据需求填写以下字段(若不使用对应模型可不填):

- OPENAI:OpenAI API 密钥(仅在使用 OpenAI 模型时填写)。

- OLLAMA:Ollama API URL,格式为

http://host.docker.internal:PORT_NUMBER(例如,若 Ollama 安装在端口 11434,则填写http://host.docker.internal:11434;使用其他端口时需相应调整)。 - GROQ:Groq API 密钥(仅在使用 Groq 模型时填写)。

- ANTHROPIC:Anthropic API 密钥(仅在使用 Anthropic 模型时填写)。

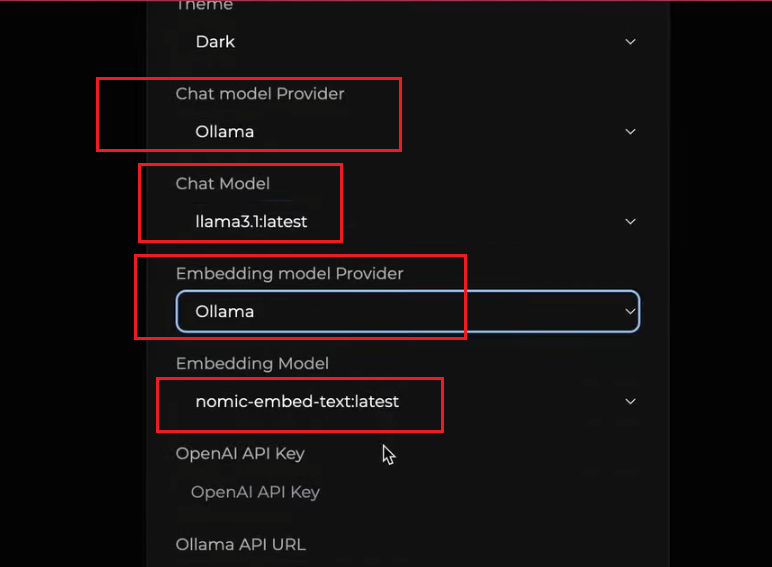

自定义模型

通过与Ollama集成,实现了丰富的模型库,包括Qwen、Llama等1700+大语言模型。

选择模型:

完成后我们现在可以使用它了。

总结

Perplexica 是一款开源的 AI 搜索引擎项目,融合先进机器学习算法,支持本地 LLMs,具备多模式(正常、CoPilot 及多种焦点模式)与多模态(图像、视频)搜索功能,可通过 Docker 或非 Docker 方式安装,能精准理解用户意图提供答案并引来源,在学术、写作、生活、专业和企业等多领域有广泛应用,注重隐私保护且高度灵活可定制,其开源性推动搜索技术创新,有力提升用户搜索体验并有着广阔的应用拓展前景。

项目地址

https://github.com/ItzCrazyKns/Perplexica